Deepfakes: Social Engineering 2.0 in Zeiten von Phishing mit KI

Wie KI Cyberkriminelle befähigt, Mitarbeitende mit Deepfakes & Audio-Fälschungen zu manipulieren. Raffinierte Angriffe!

Deepfakes und Social Engineering stellen eine neue Dimension der Manipulation dar, die sowohl technologische als auch psychologische Aspekte umfasst. Während Deepfakes mithilfe künstlicher Intelligenz täuschend echte Medieninhalte erzeugen, zielt Social Engineering darauf ab, menschliches Verhalten zu manipulieren. Beide Technologien ermöglichen Cyberkriminellen, ihre Angriffe auf ein neues Level zu heben.

Generative KI eröffnet nicht nur Möglichkeiten für innovative Entwicklungen, sondern bietet auch Cyberkriminellen die Chance, Straftaten, insbesondere im Bereich der Cyberkriminalität, durch den Einsatz von Social Engineering 2.0 zu begehen. Die Fähigkeit von generativer KI, Texte, Bilder und sogar Sprache zu generieren, birgt viele potenzielle Gefahren.

Für Unternehmen und Einzelpersonen bedeutet dies eine wachsende Bedrohung. Laut Prognosen könnten Deepfake-Betrügereien bis 2027 weltweit Verluste von bis zu 40 Milliarden US-Dollar verursachen. Die Relevanz dieser Technologien zeigt sich auch in der zunehmenden Anzahl von Angriffen auf kritische Infrastrukturen, die sowohl Finanzinstitute als auch Gesundheitseinrichtungen betreffen.

Wichtige Erkenntnisse

Deepfakes nutzen künstliche Intelligenz, um sehr echte Medien zu machen. Diese Technik kann gefährlich für Firmen und Menschen sein.

Social Engineering beeinflusst Menschen, um geheime Infos zu bekommen. Angreifer nutzen Tricks wie Vertrauen und Macht aus.

Zusammen machen Deepfakes und Social Engineering Angriffe stärker. Angreifer können echte Videos oder Audios erstellen, um zu täuschen.

Firmen sollten oft Schulungen und Programme anbieten. Diese helfen, Gefahren zu erkennen und Mitarbeiter zu schützen.

Kritisches Denken hilft, Deepfakes zu erkennen. Prüfen Sie Inhalte und Quellen, bevor Sie etwas glauben oder teilen.

Technik wie KI-Tools und Blockchain kann Deepfakes finden. Sie hilft, digitale Inhalte sicherer zu machen.

Phishing-Angriffe sind oft genutzte Tricks im Social Engineering. Sicherheitssoftware schützt vor falschen E-Mails.

Eine gute Sicherheitskultur macht Firmen sicherer. Alle Mitarbeiter sollten mithelfen, sicher zu bleiben.

Deepfakes: Technologie und Funktionsweise

Ursprung und Definition

Der Begriff "Deepfake" wurde erstmals 2017 auf Reddit verwendet. Ein Nutzer mit dem Pseudonym "deepfakes" veröffentlichte manipulierte Videos, die mithilfe künstlicher Intelligenz erstellt wurden. Seitdem hat sich die Technologie rasant weiterentwickelt und ist heute ein Synonym für KI-basierte Manipulation von Medieninhalten.

Der Begriff beschreibt die Nutzung von KI, um Videos, Bilder oder Audiodateien zu verändern.

Ursprünglich diente die Technologie der Unterhaltung, doch Cyberkriminelle haben sie schnell für betrügerische Zwecke adaptiert.

Technologische Grundlagen

Generative Adversarial Networks (GANs)

GANs bilden die Grundlage für die Erstellung von Deepfakes. Diese Netzwerke bestehen aus zwei neuronalen Netzen: einem Generator und einem Diskriminator. Der Generator erstellt gefälschte Inhalte, während der Diskriminator versucht, diese von echten Inhalten zu unterscheiden. Durch diesen Wettbewerb verbessern sich beide Netzwerke kontinuierlich. Du kannst dir GANs wie einen Künstler und einen Kritiker vorstellen, die sich gegenseitig herausfordern, bis die Fälschungen nahezu perfekt sind.

Deep Neural Networks (DNNs)

DNNs sind ein weiterer wichtiger Bestandteil der Deepfake-Technologie. Diese Netzwerke analysieren riesige Datenmengen, um Muster zu erkennen und realistische Inhalte zu erzeugen. Sie ermöglichen es, Gesichter in Videos nahtlos auszutauschen oder Stimmen täuschend echt zu imitieren. Laut einem Bericht von Signicat sind 42,5 % der Betrugsversuche im Finanzsektor inzwischen auf KI zurückzuführen. Vor drei Jahren spielten Deepfakes kaum eine Rolle, doch heute sind sie die häufigste Form des digitalen Identitätsbetrugs.

Arten von Deepfakes

Video- und Audio-Manipulation

Die bekannteste Form von Deepfakes ist die Manipulation von Videos und Audiodateien. Dabei werden Gesichter in Videos ausgetauscht oder Stimmen so verändert, dass sie von den Originalen kaum zu unterscheiden sind. Diese Technik wird häufig für Betrugsversuche oder politische Propaganda eingesetzt.

Textgenerierung

Neben visuellen und auditiven Inhalten können Deepfakes auch Texte generieren. KI-Modelle wie GPT-3 erstellen täuschend echte Nachrichtenartikel, E-Mails oder Social-Media-Beiträge. Diese Texte wirken authentisch und können gezielt eingesetzt werden, um Desinformation zu verbreiten oder Vertrauen zu missbrauchen.

Social Engineering: Psychologische Manipulation

Definition und Ziele

Social Engineering bezeichnet die gezielte Manipulation von Menschen, um vertrauliche Informationen zu erhalten oder bestimmte Handlungen auszulösen. Dabei nutzen Angreifer psychologische Prinzipien wie Vertrauen, Reziprozität oder Autorität aus, um ihre Opfer zu täuschen. Das Hauptziel besteht darin, Zugang zu sensiblen Daten oder Systemen zu erlangen, ohne technische Sicherheitsmaßnahmen zu überwinden.

Studien zeigen, dass viele Mitarbeiter leicht manipulierbar sind und kritische Daten preisgeben. Ein bekanntes Beispiel ist der Fall der Leoni AG, bei dem ein Social-Engineering-Angriff zu einem finanziellen Verlust in Millionenhöhe führte. Solche Angriffe verdeutlichen, wie gefährlich diese Methode für Unternehmen sein kann.

Häufige Techniken

Phishing und Spear-Phishing

Phishing zählt zu den häufigsten Social-Engineering-Techniken. Angreifer senden gefälschte E-Mails, die oft wie offizielle Mitteilungen aussehen, um Opfer zur Preisgabe von Passwörtern oder anderen sensiblen Informationen zu bewegen. Ein Beispiel ist ein Angriff auf ein Finanzunternehmen, bei dem Mitarbeiter auf einer gefälschten Webseite ihre Anmeldedaten eingaben.

Spear-Phishing geht noch einen Schritt weiter. Hierbei werden gezielte Angriffe auf Einzelpersonen durchgeführt, oft basierend auf zuvor gesammelten Informationen. Diese Methode erhöht die Erfolgswahrscheinlichkeit erheblich, da die Nachrichten personalisiert und glaubwürdiger wirken.

Pretexting und Baiting

Beim Pretexting erstellen Angreifer eine fiktive Geschichte, um das Vertrauen ihrer Opfer zu gewinnen. Ein Beispiel ist ein Anruf, bei dem sich der Angreifer als IT-Support ausgibt, um Zugangsdaten zu erhalten.

Baiting hingegen lockt Opfer mit einem vermeintlich attraktiven Angebot, wie einem kostenlosen Download oder einem USB-Stick, der absichtlich an einem öffentlichen Ort platziert wird. Sobald das Opfer darauf zugreift, erhält der Angreifer Zugang zu sensiblen Daten oder Systemen.

Verbindung zu Deepfakes

Verstärkung von Angriffen durch audiovisuelle Täuschung

Deepfakes haben Social Engineering auf ein neues Level gehoben. Mit dieser Technologie können Angreifer realistisch wirkende Videos oder Audioaufnahmen erstellen, die es ihnen ermöglichen, Personen täuschend echt zu imitieren. Beispielsweise könnten sie die Stimme eines CEOs nachahmen, um eine Buchhaltungsabteilung zur Durchführung einer Überweisung zu bewegen.

Durch maschinelles Lernen können Deepfakes menschenähnliche Verhaltensweisen nachahmen, was die Glaubwürdigkeit solcher Angriffe erheblich steigert. Diese Täuschungen machen maßgeschneiderte Phishing-Angriffe noch effektiver, da sie gezielt auf bestimmte Personen oder Organisationen abzielen.

Hinweis: Die Kombination aus Social Engineering und Deepfakes stellt eine erhebliche Bedrohung dar. Unternehmen sollten daher verstärkt in Schulungen und Sicherheitsmaßnahmen investieren, um sich vor solchen Angriffen zu schützen.

Risiken und reale Beispiele

Deepfake-Angriffe in der Praxis

Business Email Compromise (BEC)

Deepfakes haben die Bedrohung durch Business Email Compromise (BEC) erheblich verschärft. Angreifer nutzen täuschend echte Videos oder Audioaufnahmen, um sich als Führungskräfte oder Geschäftspartner auszugeben. Diese Technologie ermöglicht es ihnen, Überweisungen oder sensible Informationen zu erschleichen.

Ein Vorfall in Hongkong verdeutlicht die Gefahr: Ein Mitarbeiter wurde durch Deepfake-Technologie dazu gebracht, über 25 Millionen US-Dollar zu überweisen. Solche Angriffe zeigen, wie effektiv diese Technologie für kriminelle Zwecke eingesetzt werden kann.

Politische Manipulation

Deepfakes spielen auch eine zentrale Rolle in der politischen Manipulation und sind ein Beispiel für den Einsatz von künstlicher Intelligenz in Zeiten von Social Engineering 2.0. Ein Beispiel ist die slowakische Präsidentschaftswahl 2023, bei der eine gefälschte Audioaufnahme verbreitet wurde. Diese Aufnahme beeinflusste die öffentliche Meinung und führte zu erheblichen politischen Spannungen.

Politische Deepfakes gefährden die Demokratie, indem sie das Vertrauen in öffentliche Institutionen untergraben. Sie können gezielt eingesetzt werden, um Desinformation zu verbreiten und Wahlen zu manipulieren. Politiker und Experten fordern daher verstärkte Maßnahmen, um die Öffentlichkeit für diese Risiken zu sensibilisieren.

Auswirkungen auf Unternehmen und Gesellschaft

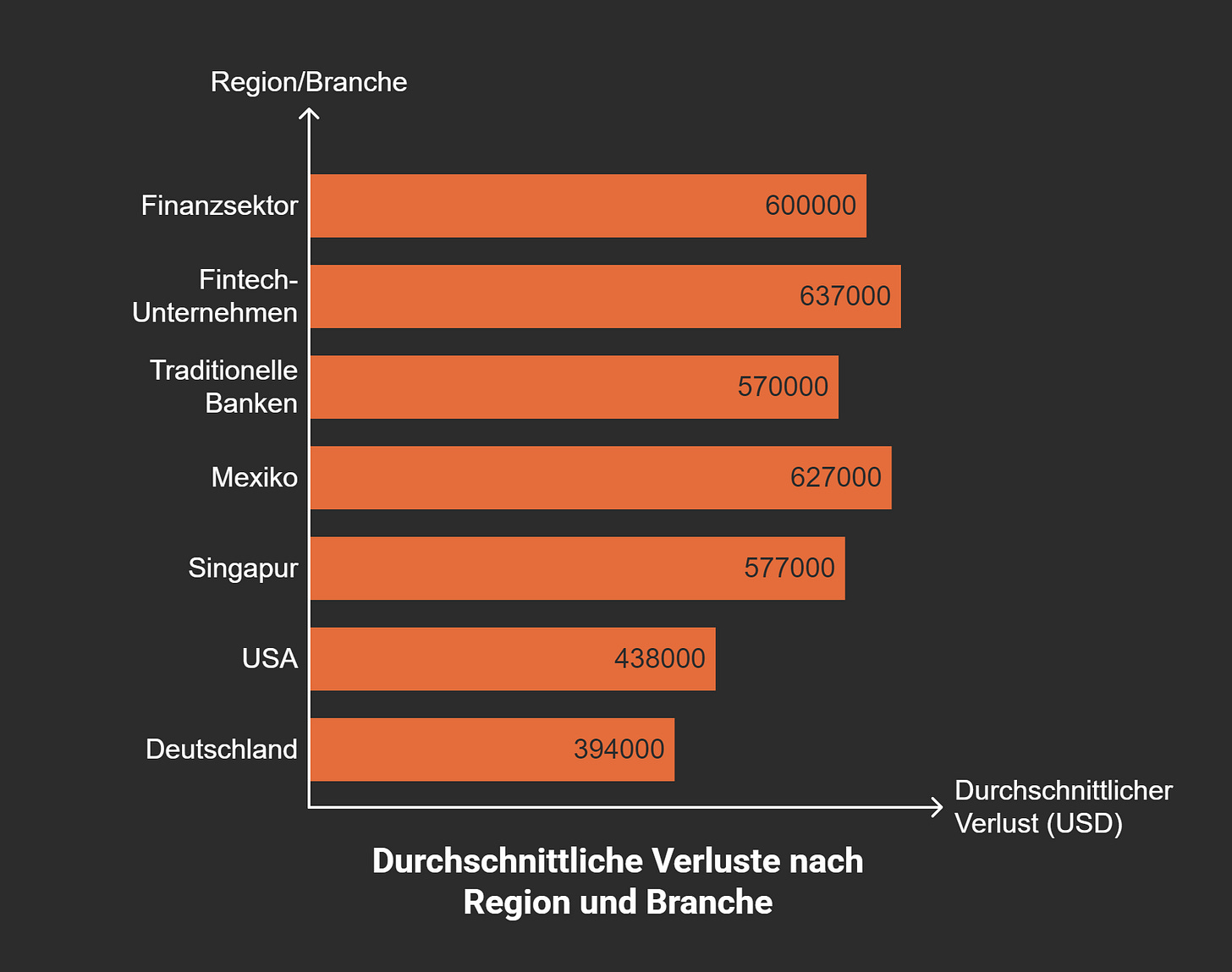

Finanzielle Schäden

Die finanziellen Auswirkungen von Deepfake-Angriffen sind enorm. Unternehmen weltweit berichten von erheblichen Verlusten durch diese Technologie. Besonders betroffen ist der Finanzsektor, wo durchschnittliche Verluste von bis zu 600.000 US-Dollar pro Angriff gemeldet werden.

Zusätzlich zeigen Studien, dass 23 % der Finanzorganisationen Verluste von mehr als 1 Million US-Dollar erlitten haben. Diese Zahlen verdeutlichen die Dringlichkeit, effektive Schutzmaßnahmen gegen Deepfakes und Phishings zu entwickeln.

Verbreitung von Desinformation

Deepfakes tragen erheblich zur Verbreitung von Desinformation bei. Sie werden im Journalismus, in der Politik und in der Wirtschaft als Risiko betrachtet. Besonders ältere Menschen sind anfällig, da es oft an Aufklärungsangeboten fehlt.

Die Mehrheit der Fachleute sieht Deepfakes in Deutschland als weniger bedeutend im Vergleich zu anderen Desinformationsformen.

Die Gefahren liegen vor allem in der Wahrnehmung und der immer schwierigeren Unterscheidung zwischen Realität und Fälschung. Sensibilisierung der Öffentlichkeit.

Politiker äußern Bedenken über die negativen Auswirkungen auf Demokratie und politische Institutionen.

Die Studie betont die Notwendigkeit, das Publikum für Deepfakes zu sensibilisieren und Wissen zur Überprüfung von Inhalten zu vermitteln. Ohne ausreichende Schutzmaßnahmen könnten diese Technologien das Vertrauen in Medien und Institutionen weiter schwächen.

Erkennung und Abwehr von Deepfakes

Technologische Lösungen

KI-gestützte Tools

Um Deepfakes zu erkennen, setzen Experten zunehmend auf KI-gestützte Tools. Diese Programme analysieren digitale Inhalte und identifizieren typische Merkmale von Manipulationen. Beispielsweise können sie unnatürliche Bewegungen, fehlerhafte Lichtreflexionen oder inkonsistente Gesichtsausdrücke erkennen. Tools wie Deepware Scanner oder Sensity AI bieten Unternehmen und Einzelpersonen die Möglichkeit, verdächtige Videos oder Audiodateien zu überprüfen.

Ein weiterer Vorteil dieser Technologien liegt in ihrer kontinuierlichen Weiterentwicklung. Mit jedem neuen Deepfake, den Angreifer erstellen, lernen diese Tools dazu. Du kannst sie als eine Art digitale Detektive betrachten, die ständig auf der Suche nach Anomalien sind.

Blockchain-Technologie

Die Blockchain-Technologie bietet eine innovative Möglichkeit, die Authentizität digitaler Inhalte zu gewährleisten. Durch die Speicherung von Metadaten, wie Zeitstempel oder Herkunftsinformationen, in einer unveränderlichen Blockchain können Inhalte überprüft werden. Wenn ein Video oder Bild manipuliert wurde, zeigt die Blockchain dies sofort an.

Ein Beispiel für den Einsatz dieser Technologie ist die Initiative "Content Authenticity Initiative" (CAI). Sie ermöglicht es, die Herkunft und Integrität von Medieninhalten zu überprüfen. Für dich als Nutzer bedeutet dies mehr Sicherheit und Transparenz im Umgang mit digitalen Medien.

Praktische Tipps

Kritisches Denken

Kritisches Denken ist eine der effektivsten Waffen gegen Deepfakes. Du solltest Inhalte immer hinterfragen, bevor du sie teilst oder darauf reagierst. Achte auf Details wie unnatürliche Bewegungen, inkonsistente Audioqualität oder ungewöhnliche Gesichtsausdrücke. Diese können Hinweise auf eine Manipulation sein.

Ein weiterer Tipp: Vertraue nicht blind auf Inhalte, die emotional aufgeladen sind. Angreifer nutzen oft provokative oder schockierende Inhalte, um dich zu manipulieren. Bleibe ruhig und analysiere die Situation objektiv.

Überprüfung von Quellen

Die Überprüfung von Quellen ist ein weiterer wichtiger Schritt, um Deepfakes zu entlarven. Du solltest immer prüfen, ob die Inhalte von einer vertrauenswürdigen Quelle stammen. Nutze offizielle Webseiten, Nachrichtenportale oder Verifizierungsdienste, um die Echtheit von Informationen zu bestätigen.

Ein praktisches Beispiel: Wenn du ein Video siehst, das eine bekannte Persönlichkeit zeigt, überprüfe, ob andere seriöse Medien darüber berichten. Falls nicht, könnte es sich um einen Deepfake handeln. Mit diesen einfachen Maßnahmen kannst du dich effektiv vor Manipulation schützen.

Schutzmaßnahmen gegen Deepfakes und Social Engineering

Schulungen und Sensibilisierung

Awareness-Programme

Awareness-Programme sind essenziell, um dich und dein Team auf die Gefahren von Deepfakes und Social Engineering vorzubereiten. Solche Programme vermitteln grundlegendes Wissen über die Erkennung von Manipulationen und fördern ein kritisches Bewusstsein. Studien zeigen, dass Mitarbeitersensibilisierung eine der effektivsten Maßnahmen ist, um Fehlinformationen und betrügerische Inhalte rechtzeitig zu erkennen.

Der Finanzsektor hat erkannt, wie wichtig Schulungen sind, um das Bewusstsein für Bedrohungen zu schärfen. Regelmäßige Fortbildungen und praxisnahe Trainings helfen dir, verdächtige E-Mails oder Links zu identifizieren. Besonders wichtig ist es, dass alle Mitarbeitenden wissen, wie sie Phishing-Angriffe erkennen und darauf reagieren können.

Simulation von Angriffen

Realistische Angriffssimulationen sind eine weitere effektive Methode, um dich auf potenzielle Bedrohungen vorzubereiten. Diese Simulationen testen, wie gut du und dein Team auf Cyberangriffe reagieren können. Awareness-Schulungen in Kombination mit Angriffssimulationen verbessern nachhaltig den Umgang mit Cybergefahren.

Eine Studie zeigt, dass kontinuierliche Fortbildungen und regelmäßige Schulungen die Zufriedenheitsrate der Teilnehmer auf 90,3 % steigern. Gleichzeitig liegt die durchschnittliche Beteiligungsquote bei 9 von 10 Mitarbeitenden. Solche Programme stärken nicht nur deine Fähigkeiten, sondern auch das Sicherheitsbewusstsein in deinem Unternehmen.

Sicherheitssoftware

Tools zur Deepfake-Erkennung

Sicherheitssoftware spielt eine entscheidende Rolle bei der Abwehr von Deepfakes. Tools zur Deepfake-Erkennung analysieren digitale Inhalte und identifizieren Manipulationen. Sie erkennen beispielsweise unnatürliche Bewegungen oder inkonsistente Gesichtsausdrücke. Der Einsatz solcher Technologien ist besonders wichtig, da Deepfake-Technologie zunehmend bei Spear-Phishing-Angriffen verwendet wird.

Einige der effektivsten Technologien umfassen:

KI-gestützte Bedrohungserkennung: Diese analysiert Muster in Videos und filtert verdächtige Inhalte.

Blockchain-basierte Authentifizierung: Diese Technologie gewährleistet die Integrität digitaler Inhalte.

Schutz vor Phishing

Phishing-Angriffe stellen eine der häufigsten Bedrohungen dar. Sicherheitssoftware kann dir helfen, diese Angriffe zu erkennen und abzuwehren. Technologien wie DMARC, SPF und DKIM validieren die Echtheit des Absenders und schützen dich vor gefälschten E-Mails.

Weitere effektive Maßnahmen umfassen:

DNS-Sicherheit: DNSSEC schützt vor Manipulationen an DNS-Einträgen.

Zwei-Faktor-Authentifizierung (2FA): Diese reduziert das Risiko von Account-Übernahmen erheblich.

Phishing-Simulationen: Diese identifizieren Schwachstellen in deinem Unternehmen.

Durch den Einsatz solcher Tools kannst du die Sicherheit deiner Systeme erheblich verbessern und dich vor Cyberangriffen schützen.

Sicherheitskultur

Wachsamkeit und Verantwortungsbewusstsein

Eine starke Sicherheitskultur ist die Grundlage für den Schutz vor Deepfakes und Social Engineering. Du solltest in deinem Unternehmen eine Kultur der Wachsamkeit fördern, in der alle Mitarbeitenden Verantwortung für die Sicherheit übernehmen.

Ein wichtiger Schritt ist die Etablierung klarer Meldewege. Definierte Prozesse zur Meldung verdächtiger Inhalte erleichtern es dir und deinem Team, schnell auf Bedrohungen zu reagieren. Interaktive Trainings und regelmäßige Sicherheitsupdates stärken das Verantwortungsbewusstsein und fördern eine proaktive Haltung gegenüber Cybergefahren.

Tipp: Wachsamkeit beginnt bei dir. Hinterfrage Inhalte kritisch, überprüfe Quellen und teile dein Wissen mit deinem Team. Gemeinsam könnt ihr eine starke Verteidigung gegen Manipulationen aufbauen.

Zukunftsperspektiven und Herausforderungen

Weiterentwicklung der Technologien

Fortschritte in der KI

Die rasante Entwicklung der KI-Technologien eröffnet neue Möglichkeiten, birgt jedoch auch erhebliche Risiken. Du wirst feststellen, dass die Geschwindigkeit, mit der neue Deepfake-Software entwickelt wird, die Erkennungstechnologien oft überholt. Fortschritte wie Face Swapping, Facial Reenactment und Voice Cloning ermöglichen es, täuschend echte Inhalte zu erstellen. Diese Technologien erlauben es, Gesichter in Echtzeit zu manipulieren oder Stimmen so zu klonen, dass sie kaum von den Originalen zu unterscheiden sind.

Experten prognostizieren, dass böswillige Akteure bis 2025 verstärkt KI-gestützte Tools nutzen werden, um ihre Angriffe zu optimieren. Besonders im Bereich des Identitätsdiebstahls und Betrugs wird ein Anstieg erwartet. Gleichzeitig arbeiten Forscher an KI-Detektionstechnologien, die Unregelmäßigkeiten in Videos und Audiodateien erkennen können. Diese Fortschritte sind entscheidend, um die wachsende Bedrohung durch Deepfakes einzudämmen.

Potenzial für positive Anwendungen

Trotz der Risiken bietet die Weiterentwicklung der KI auch positive Perspektiven. Du kannst dir vorstellen, wie diese Technologien in der Medizin, Bildung oder Unterhaltung eingesetzt werden könnten, um innovative Videos zu erstellen. Beispielsweise könnten Ärzte mithilfe von KI realistische Simulationen für chirurgische Eingriffe erstellen. In der Bildung könnten virtuelle Lehrer mit Deepfake-Technologie personalisierte Lerninhalte anbieten.

Ein weiteres Beispiel ist die Nutzung von KI zur Bewahrung kulturellen Erbes. Historische Persönlichkeiten könnten durch Deepfake-Technologie "zum Leben erweckt" werden, um interaktive Videos zu erstellen, die Geschichte nachhaltig für Social Engineering vermitteln. Diese Anwendungen zeigen, dass KI nicht nur eine Bedrohung darstellt, sondern auch einen erheblichen Mehrwert für die Gesellschaft schaffen kann.

Sicherheitsbewusstsein

Rolle von Regierungen

Regierungen spielen eine zentrale Rolle bei der Regulierung und Bekämpfung von Deepfakes. Du kannst darauf vertrauen, dass internationale Ansätze zur Förderung von Sicherheitsmaßnahmen bereits existieren. Ein rechtlicher Rahmen ist notwendig, um Innovationen zu fördern und gleichzeitig öffentliche Interessen zu schützen.

Zwei Ansätze zur Erkennung von Deepfakes haben sich etabliert: biometrische und semantische Methoden. Biometrische Verfahren analysieren physische Merkmale wie Gesichtszüge, während semantische Ansätze den Inhalt und Kontext von Medien überprüfen. Regierungen investieren zunehmend in KI-Algorithmen, die Überwachungssysteme verbessern und automatisierte Reaktionsstrategien ermöglichen.

Internationale Zusammenarbeit

Die Bekämpfung von Deepfakes erfordert eine enge Zusammenarbeit zwischen Ländern. Du wirst sehen, dass internationale Organisationen und Technologieunternehmen gemeinsam an Standards für die Authentizitätsvalidierung arbeiten. Diese Kooperationen sind entscheidend, um globale Sicherheitsbedrohungen zu minimieren.

Ein Beispiel ist die Entwicklung von Plattformen, die digitale Inhalte mit Zeitstempeln und Herkunftsinformationen versehen. Solche Technologien könnten weltweit eingesetzt werden, um die Verbreitung manipulierter Inhalte zu verhindern. Internationale Zusammenarbeit stärkt nicht nur die Sicherheit, sondern fördert auch das Vertrauen in digitale Medien.

Hinweis: Die Zukunft der KI-Technologien hängt von einem ausgewogenen Ansatz ab. Fortschritte müssen mit robusten Sicherheitsmaßnahmen einhergehen, um die Vorteile zu maximieren und die Risiken zu minimieren.

Deepfakes und Social Engineering stellen erhebliche Risiken für Unternehmen und Einzelpersonen dar. Sie gefährden finanzielle Sicherheit, Vertrauen und gesellschaftliche Stabilität. Prävention und Wachsamkeit sind entscheidend, um diesen Bedrohungen entgegenzuwirken.

Tipp: Schulen Sie Ihr Team regelmäßig und nutzen Sie moderne Sicherheitslösungen, um Manipulationen frühzeitig zu erkennen.

Du kannst aktiv zur Sicherheit beitragen, indem du dich über neue Technologien informierst und verdächtige Inhalte kritisch hinterfragst. Unternehmen und Einzelpersonen müssen Verantwortung übernehmen, um gemeinsam eine sichere digitale Zukunft zu gestalten.

FAQ

Was sind Deepfakes und wie funktionieren sie?

Deepfakes sind KI-generierte Medien, die täuschend echt wirken. Sie basieren auf Technologien wie Generative Adversarial Networks (GANs), die Bilder, Videos oder Audiodateien manipulieren. Diese Netzwerke lernen aus großen Datenmengen, um realistische Inhalte zu erstellen.

Wie können Sie Deepfakes erkennen?

Achten Sie auf unnatürliche Bewegungen, inkonsistente Lichtverhältnisse oder fehlerhafte Gesichtsausdrücke. Nutzen Sie Tools wie Deepware Scanner oder Sensity AI, um verdächtige Inhalte zu analysieren. Kritisches Denken und die Überprüfung von Quellen sind ebenfalls entscheidend.

Welche Risiken bergen Deepfakes für Unternehmen?

Deepfakes können für Betrug, Identitätsdiebstahl oder Desinformation genutzt werden. Unternehmen riskieren finanzielle Verluste, Rufschädigung und Datenlecks. Besonders gefährlich sind Angriffe wie Business Email Compromise (BEC), bei denen gefälschte Videos oder Audios verwendet werden.

Was ist Social Engineering und warum ist es gefährlich?

Social Engineering ist die Manipulation von Menschen, um vertrauliche Informationen zu erhalten. Angreifer nutzen psychologische Tricks wie Vertrauen oder Autorität. Diese Methode umgeht technische Sicherheitsmaßnahmen und zielt direkt auf menschliche Schwächen ab.

Wie können Sie sich vor Social Engineering schützen?

Seien Sie skeptisch gegenüber unerwarteten Anfragen nach sensiblen Informationen. Überprüfen Sie die Identität des Absenders und nutzen Sie Zwei-Faktor-Authentifizierung. Regelmäßige Schulungen und Awareness-Programme helfen, potenzielle Angriffe frühzeitig zu erkennen.

Welche Rolle spielen Deepfakes bei Social-Engineering-Angriffen?

Deepfakes verstärken Social-Engineering-Angriffe, indem sie realistisch wirkende Videos oder Audios erstellen. Angreifer können beispielsweise die Stimme eines CEOs imitieren, um Überweisungen zu veranlassen. Diese Kombination erhöht die Glaubwürdigkeit und Effektivität solcher Angriffe.

Gibt es rechtliche Maßnahmen gegen Deepfakes?

Viele Länder entwickeln Gesetze, um den Missbrauch von Deepfakes zu regulieren. In Deutschland können Deepfake-Angriffe unter Straftatbestände wie Betrug oder Identitätsdiebstahl fallen. Internationale Zusammenarbeit ist entscheidend, um globale Standards zu schaffen.

Welche Technologien helfen bei der Bekämpfung von Deepfakes?

KI-gestützte Tools und Blockchain-Technologie sind effektive Lösungen. KI erkennt Manipulationen durch Analyse von Mustern und Anomalien. Blockchain speichert Metadaten, um die Authentizität digitaler Inhalte zu gewährleisten. Diese Technologien bieten Unternehmen und Einzelpersonen Schutz vor Täuschung.

Was sind Deepfakes und wie werden sie im Social Engineering eingesetzt?

Deepfakes sind täuschend echte Fälschungen von Videos oder Audio, die mithilfe von künstlicher Intelligenz erstellt werden. Im Social Engineering werden sie verwendet, um Menschen zu manipulieren und sensible Informationen preiszugeben, indem sie als vertrauenswürdige Personen auftreten.

Wie können Phishing-Angriffe durch den Einsatz von KI verbessert werden?

Cyber-Kriminelle nutzen KI, um raffinierte Phishing-Angriffe zu entwickeln, die schwerer zu erkennen sind. Durch den Einsatz von Technologien wie Deepfake können sie gefälschte Audio- oder Videoanrufe erstellen, die das Vertrauen der Opfer gewinnen und sie dazu bringen, sensible Informationen preiszugeben.

Welche Rolle spielt die Sensibilisierung bei der Bekämpfung von Deepfake-basiertem Social Engineering?

Die Sensibilisierung ist entscheidend, um Mitarbeitende über die neuesten Entwicklungen im Bereich Social Engineering und moderne Technologien zu informieren. Schulungen können helfen, das Bewusstsein für die Risiken von Deepfakes und Phishing-Angriffen zu schärfen und somit das Risiko der Preisgabe sensibler Informationen zu verringern.

Welche Angriffsmethoden nutzen Cyber-Kriminelle im Kontext von Deepfakes?

Cyber-Kriminelle nutzen eine Vielzahl von Angriffsmethoden, die Deepfakes beinhalten, darunter die Erstellung gefälschter Videos oder Audio-Anrufe, um als Vorgesetzte oder vertrauenswürdige Personen aufzutreten. Diese Methoden zielen darauf ab, das Opfer zu manipulieren und zu einem einzigen Klick auf einen schädlichen Link zu bewegen.

Wie können Unternehmen ihre Mitarbeitenden vor Deepfake-Bedrohungen schützen?

Unternehmen können ihre Mitarbeitenden schützen, indem sie regelmäßige Schulungen zur Sensibilisierung für Deepfakes und Phishing-Angriffe anbieten. Außerdem sollten sie Richtlinien zur Überprüfung von Informationen und Kommunikationskanälen einführen, um sicherzustellen, dass Mitarbeitende nicht auf gefälschte Inhalte hereinfallen.

Was sind die Risiken von Deepfake-Videos in Geschäftsprozessen?

Die Risiken von Deepfake-Videos in Geschäftsprozessen sind hoch, da sie zur Manipulation von Mitarbeitenden führen können, die dann falsche Informationen weitergeben oder auf schädliche Links klicken. Dies kann zu finanziellen Verlusten und einem Vertrauensverlust innerhalb des Unternehmens führen.

Wie kann der Einsatz von KI im Social Engineering nachhaltig für Unternehmen sein?

Der Einsatz von KI im Social Engineering ist für Unternehmen nachhaltig, wenn sie proaktiv Maßnahmen ergreifen, um ihre Mitarbeitenden zu schulen und die Technologien zu verstehen, die Cyber-Kriminelle verwenden. Dies hilft, die Resilienz gegen Phishing-Angriffe zu erhöhen und das Risiko von Datenverlusten zu minimieren.

Welche Schritte sollten unternommen werden, um Informationen vor Deepfake-Angriffen zu schützen?

Um Informationen vor Deepfake-Angriffen zu schützen, sollten Unternehmen klare Kommunikationsrichtlinien festlegen, Mitarbeitende schulen und Technologien zur Erkennung von Deepfakes einsetzen. Zudem ist es wichtig, bei verdächtigen Anfragen immer eine zweite Bestätigung einzuholen.