Die rechtlichen Rahmenbedingungen für Künstliche Intelligenz haben sich seit 2024 durch den EU AI Act grundlegend verändert. Der neue Rechtsrahmen verfolgt einen risikobasierten Ansatz und stellt hohe Anforderungen an den Einsatz von KI-Systemen. Eine Umfrage des bidt zeigt, dass 56 % der Befragten eine stärkere Regulierung befürworten, während 44 % den Schutz der Persönlichkeitsrechte durch die neue Verordnung verbessert sehen. Diese Entwicklungen beeinflussen sowohl juristische Praxis als auch gesellschaftliche Erwartungen spürbar.

Wichtige Erkenntnisse

Künstliche Intelligenz verändert die juristische Arbeit stark und automatisiert viele Routineaufgaben, was Zeit spart und die Effizienz erhöht.

Der EU AI Act schafft klare Regeln für den Einsatz von KI und fordert von Unternehmen hohe Sicherheits- und Transparenzstandards.

Juristen müssen sich durch Weiterbildung und Schulungen auf neue Technologien und rechtliche Anforderungen vorbereiten, um wettbewerbsfähig zu bleiben.

Datenschutz und Haftungsfragen sind zentrale Herausforderungen beim Einsatz von KI im Recht und erfordern sorgfältige Kontrolle und Dokumentation.

Transparenz und Akzeptanz sind wichtig, damit Nutzer Vertrauen in KI-Systeme gewinnen und diese verantwortungsvoll eingesetzt werden.

Entwicklung

Anfänge

Die Geschichte der Künstlichen Intelligenz beginnt in den 1950er Jahren. Wissenschaftler wie Alan Turing und John McCarthy legten die theoretischen Grundlagen. Sie entwickelten erste Programme, die einfache Aufgaben lösen konnten. In dieser Zeit entstand das Interesse an Maschinen, die eigenständig lernen und Entscheidungen treffen. Viele Forscher sahen großes Potenzial, doch die Technik blieb zunächst begrenzt. Computer verfügten über wenig Rechenleistung. Die Gesellschaft betrachtete Künstliche Intelligenz als Zukunftsvision.

Hinweis: In den frühen Jahren fehlten klare rechtliche Vorgaben. Entwickler und Unternehmen bewegten sich in einem rechtlichen Graubereich.

Erste Gesetze

Mit dem technischen Fortschritt wuchs das Bedürfnis nach rechtlichen Regelungen. Erste Gesetze bezogen sich meist auf den Datenschutz und die Nutzung von Computern. In den 1980er Jahren entstanden in Deutschland und anderen europäischen Ländern Datenschutzgesetze. Diese Gesetze schützten personenbezogene Daten vor Missbrauch. Sie bildeten die Grundlage für spätere Regelungen im Bereich der Künstlichen Intelligenz. Gesetzgeber erkannten, dass neue Technologien neue Risiken mit sich bringen. Sie begannen, spezifische Vorschriften für automatisierte Systeme zu entwickeln.

Eine Übersicht wichtiger Meilensteine:

1970: Erstes Datenschutzgesetz in Hessen

1977: Bundesdatenschutzgesetz in Deutschland

1995: EU-Datenschutzrichtlinie

Diese frühen Gesetze schufen das Fundament für die heutige Regulierung von KI-Systemen.

Technologischer Wandel

Neue Anwendungen

Juristische Arbeitsprozesse verändern sich rasant. Immer mehr Rechtsabteilungen setzen auf digitale Lösungen. Automatisierte Tools übernehmen Aufgaben, die früher viel Zeit gekostet haben. Laut dem Thomson Reuters Future of Professionals Report 2024 nutzen bereits 68 % der Rechtsabteilungen automatisierte Tools. Künstliche Intelligenz prüft Verträge, erkennt Fehler und schlägt passende Klauseln vor. Ein KI-Tool wie JuraGPT analysiert Leasingverträge und findet unklare Formulierungen. Die manuelle Arbeit bei Vertragsanalysen sinkt dadurch um bis zu 40 %.

Auch die Interaktion mit Klienten verändert sich. Digitale Assistenten beantworten Fragen zu Kosten und Dauer von Verfahren sofort. Im Steuerrecht erstellt KI in wenigen Sekunden tausende Steuersätze. Die folgende Tabelle gibt einen Überblick über aktuelle Anwendungen:

Herausforderungen

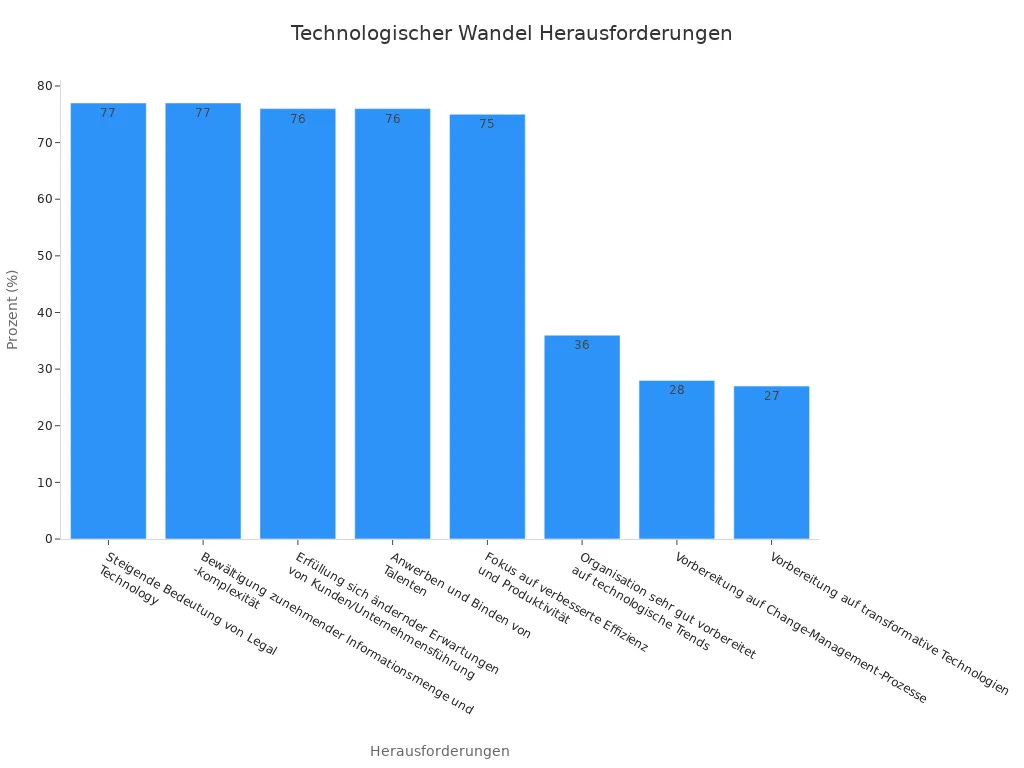

Der technologische Wandel bringt viele Chancen, aber auch große Herausforderungen. Die Informationsmenge wächst stetig. 77 % der Juristen sehen die Bewältigung dieser Komplexität als zentrale Aufgabe. Ebenso viele betonen die steigende Bedeutung von Legal Technology. Unternehmen müssen sich an neue Erwartungen von Klienten und Führungskräften anpassen. Nur 36 % der Juristen fühlen sich sehr gut vorbereitet auf technologische Trends. Die Vorbereitung auf Change-Management-Prozesse liegt sogar nur bei 28 %.

Die folgende Tabelle zeigt die wichtigsten Herausforderungen im Überblick:

Hinweis: Viele Rechtsabteilungen investieren verstärkt in Technologie, doch die Diskrepanz zwischen Anforderungen und Vorbereitung bleibt groß.

Künstliche Intelligenz im Recht

Effizienzsteigerung

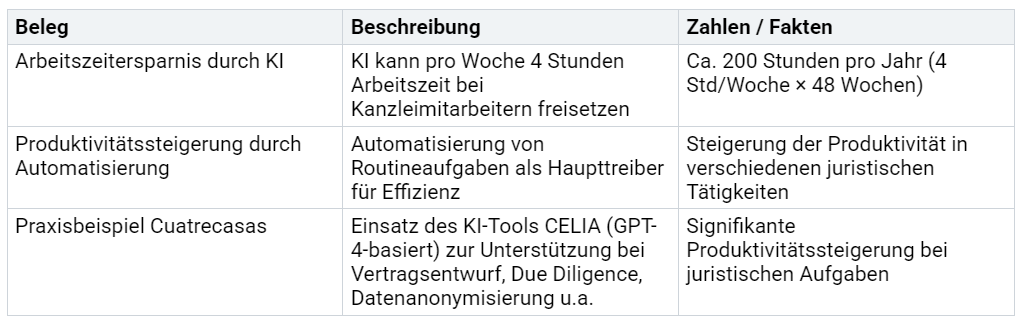

Juristische Kanzleien und Rechtsabteilungen erleben durch den Einsatz von Künstlicher Intelligenz eine deutliche Effizienzsteigerung. Moderne KI-Tools übernehmen Routineaufgaben und sparen wertvolle Arbeitszeit. Ein Beispiel: KI kann pro Woche etwa 4 Stunden Arbeitszeit bei Kanzleimitarbeitern freisetzen. Das ergibt rund 200 Stunden pro Jahr. Die Automatisierung von Standardaufgaben steigert die Produktivität in vielen Bereichen. Die Kanzlei Cuatrecasas nutzt das KI-Tool CELIA, das auf GPT-4 basiert. CELIA unterstützt beim Vertragsentwurf, bei Due Diligence und bei der Datenanonymisierung. Die folgende Tabelle zeigt die wichtigsten Effekte im Überblick:

Automatisierung

Immer mehr Unternehmen setzen auf Automatisierung im juristischen Alltag. Etwa jedes achte Unternehmen nutzt bereits KI-Lösungen. Besonders Großunternehmen mit mehr als 250 Beschäftigten greifen zu 35 % auf KI zurück. Die wichtigsten Anwendungsbereiche sind Buchführung, Controlling und IT-Sicherheit. Auch die Automatisierung von Arbeitsabläufen und die Textanalyse gewinnen an Bedeutung. Die folgende Grafik zeigt die Verteilung der KI-Nutzung in Unternehmen:

Viele Unternehmen setzen Spracherkennung und Entscheidungsunterstützung ein. Fehlendes Wissen und Unsicherheit über rechtliche Folgen bremsen jedoch die Verbreitung von KI, besonders bei kleinen Unternehmen.

Neue Aufgabenfelder

Künstliche Intelligenz eröffnet im Rechtssektor neue Aufgabenfelder. Hybride Systeme filtern und kategorisieren tausende Dokumente in kurzer Zeit. Bei M&A-Transaktionen sparen Juristen dadurch bis zu 70 % der Zeit. KI analysiert große Datenmengen in Sekunden. Juristen können sich stärker auf kreative und strategische Tätigkeiten konzentrieren, da Routineaufgaben automatisiert werden. Multimodale Assistenzsysteme passen sich an individuelle Arbeitsweisen an und verarbeiten verschiedene Datenformate. Schwarmintelligenz und Crowd-Computing ermöglichen die kollaborative Lösung komplexer Rechtsfragen. Diese Entwicklungen zeigen, dass KI nicht nur Effizienz bringt, sondern auch neue Berufsbilder im Recht schafft.

Regulierung

EU AI Act

Der EU AI Act markiert einen Wendepunkt in der Regulierung von Künstlicher Intelligenz. Die Verordnung verfolgt einen risikobasierten Ansatz. Sie teilt KI-Systeme in vier Risikoklassen ein:

Inakzeptables Risiko: Systeme mit potenziell gefährlichen Auswirkungen. Diese sind verboten.

Hohes Risiko: Strenge regulatorische Anforderungen und Compliance-Pflichten gelten. Unternehmen müssen umfangreiche Prüfungen und Dokumentationen vorlegen.

Transparenzrisiko: Offenlegungspflichten gegenüber Nutzern sind verpflichtend.

Minimales Risiko: Kaum Auflagen, geringe Regulierungsintensität.

Unternehmen, die gegen die Vorgaben verstoßen, riskieren Bußgelder von bis zu 35 Millionen Euro oder 7 % des globalen Jahresumsatzes.

Die Einführung des AI Act erfolgt in mehreren Phasen:

Die Anforderungen betreffen Anbieter und Betreiber gleichermaßen:

Viele Unternehmen sehen sich durch die neuen Vorschriften vor große Herausforderungen gestellt. 85 % der Unternehmen, die generative KI einsetzen, nennen Datenschutzanforderungen als größtes Hemmnis. 81 % sorgen sich vor künftigen rechtlichen Einschränkungen. 76 % fühlen sich durch rechtliche Unklarheiten verunsichert. Unternehmen fordern Planungssicherheit und stabile Rahmenbedingungen, insbesondere im Datenschutz.

Ein Praxisbeispiel zeigt, dass ein Automobilzulieferer durch frühzeitige Schulungen und Anpassungen Betriebsunterbrechungen vermeiden und sein Marktprofil stärken konnte. Die juristische Praxis muss sich auf neue Compliance- und Überwachungsanforderungen einstellen. Schulungen und ethische Compliance gewinnen an Bedeutung, um Risiken zu minimieren und Rechtskonformität sicherzustellen.

Data Act

Der Data Act ergänzt den AI Act und regelt den Zugang zu und die Nutzung von Daten. Ziel ist es, einen fairen Wettbewerb zu ermöglichen und Innovation zu fördern. Unternehmen müssen klare Regeln für die Datenweitergabe und -nutzung beachten. Besonders für KI-Start-ups stellen rechtliche Datenschutzregelungen (74 %) und der Zugang zu Daten (68 %) große Hürden dar. Der Data Act verpflichtet Anbieter, technische und organisatorische Maßnahmen zu treffen, um Datensicherheit und Transparenz zu gewährleisten.

Reallabore gelten als wichtiges Instrument, um KI-Lösungen und deren Risiken zu erproben. Sie helfen, Innovation und Regulierung in Einklang zu bringen. Unternehmen profitieren von klaren Vorgaben, die Planungssicherheit schaffen und Investitionen erleichtern.

DSGVO

Die Datenschutz-Grundverordnung (DSGVO) bleibt das zentrale Regelwerk für den Schutz personenbezogener Daten. Sie stellt hohe Anforderungen an die Verarbeitung und Speicherung von Daten, die für Künstliche Intelligenz genutzt werden. Unternehmen müssen Einwilligungen einholen, Daten minimieren und Transparenz gewährleisten. Die DSGVO verpflichtet zur Meldung von Datenschutzverletzungen und zur Durchführung von Datenschutz-Folgenabschätzungen.

Viele Unternehmen nennen die DSGVO als zentrales Hemmnis für den Einsatz von KI. Sie fordern klare und praktikable Regeln, um Innovation nicht zu behindern.

Die Kombination aus AI Act, Data Act und DSGVO führt zu erheblichen organisatorischen und technischen Anpassungen. Unternehmen und die juristische Praxis stehen vor der Aufgabe, neue Compliance- und Überwachungsanforderungen umzusetzen. Die Regulierung schafft einerseits Rechtssicherheit, stellt aber auch hohe Anforderungen an alle Beteiligten.

Haftung

Künstliche Intelligenz: Haftung

Die Haftung für Schäden durch Künstliche Intelligenz stellt Juristen und Unternehmen vor neue Herausforderungen. Klassische Haftungsmodelle greifen oft nicht mehr, wenn autonome Systeme eigenständig Entscheidungen treffen. Ein Beispiel: Ein KI-gestütztes System trifft eine fehlerhafte Entscheidung, die zu einem finanziellen Verlust führt. Wer trägt in diesem Fall die Verantwortung? Hersteller, Betreiber oder Nutzer? Die Antwort hängt von verschiedenen Faktoren ab, wie etwa dem Grad der Autonomie und der Möglichkeit zur Kontrolle.

Viele Experten fordern eine Anpassung der bestehenden Haftungsregeln. Die EU diskutiert spezielle Haftungsregime für KI-Systeme mit hohem Risiko. Ziel ist es, Geschädigten einen effektiven Rechtsschutz zu bieten. Unternehmen müssen ihre Systeme regelmäßig prüfen und dokumentieren. Sie sollten klare Prozesse für Fehleranalysen und Schadensmeldungen etablieren.

Tipp: Eine lückenlose Dokumentation der Systementscheidungen kann im Streitfall die Haftungsfrage erleichtern.

Verantwortlichkeit

Verantwortlichkeit bei Künstlicher Intelligenz bedeutet, dass klare Zuständigkeiten definiert werden müssen. Entwickler, Anbieter und Anwender tragen jeweils unterschiedliche Pflichten. Entwickler müssen sicherstellen, dass ihre Systeme nach anerkannten Standards arbeiten. Anbieter sind verpflichtet, Nutzer über Risiken und Einsatzgrenzen zu informieren. Anwender müssen die Systeme korrekt bedienen und überwachen.

Eine Tabelle zeigt die wichtigsten Verantwortlichkeiten:

Nur wenn alle Beteiligten ihre Aufgaben ernst nehmen, lassen sich Risiken minimieren. Die rechtliche Praxis entwickelt sich ständig weiter, um den neuen Anforderungen durch Künstliche Intelligenz gerecht zu werden.

Ethik & Gesellschaft

Transparenz

Transparenz bildet das Fundament für Vertrauen in automatisierte Systeme. Nutzer möchten wissen, wie ein Algorithmus Entscheidungen trifft. Unternehmen veröffentlichen daher häufig Informationen zu Funktionsweise und Datenquellen ihrer Systeme. Viele Organisationen setzen auf sogenannte "Explainable AI". Diese Ansätze ermöglichen es, Entscheidungswege nachvollziehbar zu machen. Ein Beispiel: Ein Versicherer erklärt, warum ein Antrag abgelehnt wurde. Transparenz hilft, Diskriminierung und Fehler frühzeitig zu erkennen.

Hinweis: Transparente Systeme fördern die Akzeptanz und erleichtern die Kontrolle durch Aufsichtsbehörden.

Akzeptanz

Die Akzeptanz neuer Technologien hängt stark von gesellschaftlichen Werten ab. Viele Menschen stehen automatisierten Entscheidungen skeptisch gegenüber. Sie befürchten Kontrollverlust oder Benachteiligung. Studien zeigen, dass klare Regeln und offene Kommunikation die Akzeptanz erhöhen. Unternehmen, die Nutzer aktiv einbinden, erzielen bessere Ergebnisse. Sie bieten Feedback-Kanäle und erklären, wie Systeme arbeiten. Schulen und Universitäten vermitteln Kompetenzen im Umgang mit digitalen Anwendungen. So wächst das Vertrauen in neue Lösungen.

Eine Übersicht wichtiger Faktoren für Akzeptanz:

Klare Kommunikation

Beteiligung der Nutzer

Nachvollziehbare Entscheidungen

Schutz vor Diskriminierung

Datenschutz

Datenschutz bleibt ein zentrales Thema im Umgang mit digitalen Technologien. Unternehmen müssen personenbezogene Daten schützen und Missbrauch verhindern. Die DSGVO verpflichtet sie, Daten nur für festgelegte Zwecke zu verwenden. Viele Organisationen setzen auf Anonymisierung und Pseudonymisierung. Sie speichern Daten sicher und begrenzen den Zugriff. Aufsichtsbehörden kontrollieren die Einhaltung der Vorschriften. Verstöße führen zu hohen Strafen.

Tipp: Regelmäßige Schulungen helfen Mitarbeitern, Datenschutz im Alltag umzusetzen.

Praxis

Anwendungen

Juristische Kanzleien nutzen Künstliche Intelligenz heute in vielen Bereichen. Ein Beispiel ist die automatisierte Dokumentenerstellung. Systeme wie Legal Tech-Tools erstellen Verträge, prüfen Klauseln und erkennen Fehler. Bei der Due Diligence analysieren KI-Programme große Mengen an Dokumenten in kurzer Zeit. Sie finden relevante Informationen und markieren Risiken. Im Bereich Compliance überwachen intelligente Systeme Transaktionen und melden verdächtige Aktivitäten. Viele Kanzleien setzen Chatbots ein, die Mandanten erste Auskünfte geben. Diese Anwendungen sparen Zeit und reduzieren Fehlerquellen.

Chancen

Künstliche Intelligenz bietet Juristen und Mandanten viele Vorteile. Sie steigert die Effizienz und senkt Kosten. Anwälte können sich auf komplexe Aufgaben konzentrieren, weil KI Routinearbeiten übernimmt. Mandanten erhalten schnellere Antworten und profitieren von einer besseren Servicequalität. Die Fehlerquote sinkt, da Systeme große Datenmengen zuverlässig auswerten. Neue Arbeitsfelder entstehen, zum Beispiel im Bereich Legal Engineering. Juristen entwickeln und überwachen KI-gestützte Prozesse. Diese Entwicklung fördert Innovation und schafft neue Karrierechancen.

Tipp: Wer sich früh mit KI-Anwendungen beschäftigt, verschafft sich einen Wettbewerbsvorteil.

Risiken

Der Einsatz von KI im Recht birgt auch Risiken. Fehlerhafte Algorithmen können zu falschen Entscheidungen führen. Mandanten könnten dadurch Nachteile erleiden. Datenschutz bleibt eine große Herausforderung. Systeme müssen sensible Daten sicher verarbeiten. Es besteht die Gefahr, dass Anwälte sich zu stark auf automatisierte Ergebnisse verlassen. Die Haftung bei Fehlentscheidungen ist oft unklar. Juristen müssen daher die Ergebnisse von KI-Systemen kritisch prüfen und Verantwortung übernehmen.

Ausblick

Trends

Die juristische Branche erlebt einen tiefgreifenden Wandel. Prognosen zeigen, dass Technologien wie maschinelles Lernen und Natural Language Processing die juristische Arbeit immer stärker prägen. Juristen nutzen heute KI-gestützte Tools, um Routineaufgaben zu automatisieren und die Effizienz bei der Rechtsanalyse zu steigern. Die Kombination aus menschlicher Expertise und digitalen Lösungen gilt als Schlüssel für den zukünftigen Erfolg. Neue Berufsbilder entstehen, während klassische Tätigkeiten sich verändern. Die folgende Tabelle verdeutlicht die Entwicklung:

Juristische Ausbildung und Praxis müssen sich an diese Trends anpassen. Datenschutz, IT-Sicherheit und ethische Fragen bleiben zentrale Herausforderungen. Die verantwortungsvolle Integration neuer Technologien steht im Fokus.

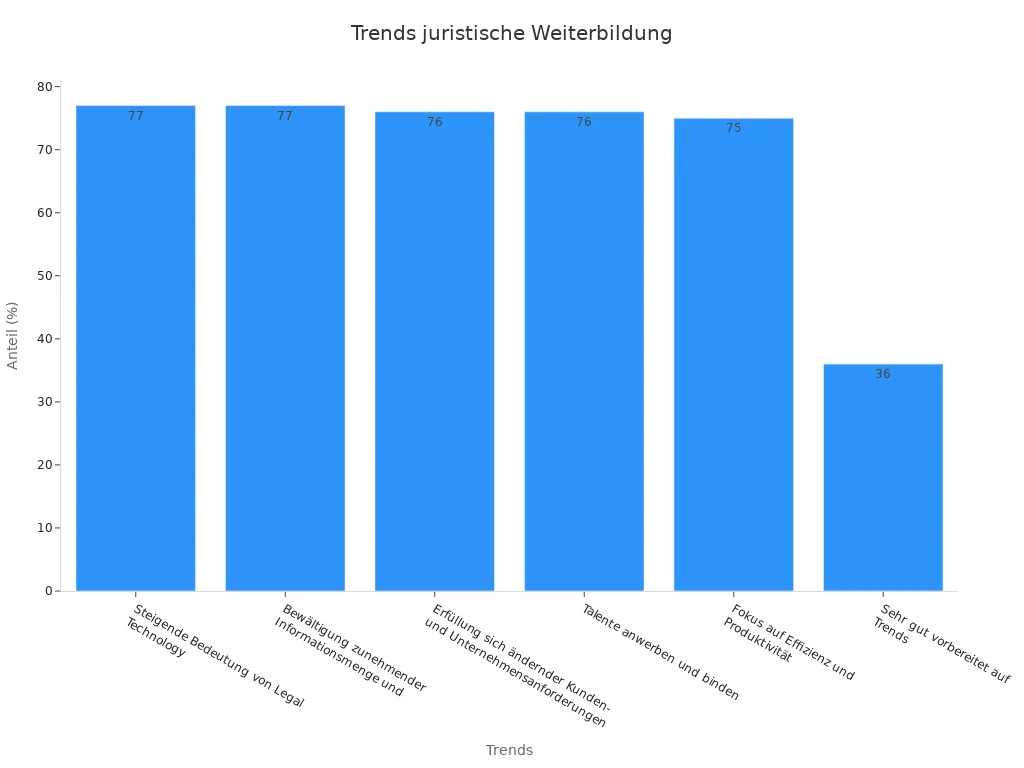

Weiterbildung

Die Geschwindigkeit, mit der neue Technologien Einzug halten, stellt hohe Anforderungen an die Qualifikation von Juristen. Kanzleien wie Cuatrecasas setzen bereits KI-Tools ein, die die Produktivität steigern und als „Co-Pilot“ im Arbeitsalltag dienen. Experten betonen, dass gezielte Weiterbildung und Umschulung entscheidend sind, um wettbewerbsfähig zu bleiben. Viele Juristen sehen die Bewältigung von Kosten- und Preisdruck, Investitionen in KI und Informationssicherheitsmanagement als wichtige Trends. Die folgende Grafik zeigt die prozentualen Anteile relevanter Herausforderungen und Trends:

Schulungen zu Informationsmanagement, Datenschutz und dem Umgang mit komplexen Technologien gewinnen an Bedeutung. Nur ein Drittel der Juristen fühlt sich sehr gut vorbereitet auf die Auswirkungen von KI. Weiterbildung bleibt daher ein zentrales Instrument, um die Chancen des digitalen Wandels zu nutzen und Risiken zu minimieren.

Die wichtigsten Entwicklungen zeigen, dass Recht und Technologie sich ständig weiterentwickeln. Juristen profitieren von neuen Tools und Methoden. Weiterbildung bleibt entscheidend, um Chancen zu nutzen und Risiken zu erkennen. Anpassungsfähigkeit sichert langfristigen Erfolg.

Wer Veränderungen aktiv begegnet, gestaltet die Zukunft des Rechts mit.

FAQ

Was ist der EU AI Act und wen betrifft er?

Der EU AI Act ist eine Verordnung der Europäischen Union. Sie regelt den Einsatz von Künstlicher Intelligenz. Unternehmen, Behörden und Entwickler, die KI-Systeme in der EU anbieten oder nutzen, müssen die Vorgaben einhalten.

Welche Vorteile bringt Künstliche Intelligenz für Juristen?

Künstliche Intelligenz automatisiert Routineaufgaben. Sie analysiert Dokumente schneller und erkennt Fehler. Juristen gewinnen Zeit für komplexe Aufgaben. Mandanten profitieren von schnelleren Antworten und höherer Servicequalität.

Wie schützt die DSGVO personenbezogene Daten bei KI-Anwendungen?

Die DSGVO schreibt vor, dass Unternehmen personenbezogene Daten nur mit Einwilligung verarbeiten. Sie müssen Daten sichern und Missbrauch verhindern. Aufsichtsbehörden kontrollieren die Einhaltung. Verstöße führen zu hohen Strafen.

Welche Risiken bestehen beim Einsatz von KI im Rechtsbereich?

Fehlerhafte Algorithmen können falsche Entscheidungen verursachen. Datenschutzprobleme und unklare Haftungslagen stellen Herausforderungen dar. Juristen müssen KI-Ergebnisse kritisch prüfen und Verantwortung übernehmen.

Wie können sich Juristen auf den technologischen Wandel vorbereiten?

Juristen sollten regelmäßig an Schulungen teilnehmen. Sie lernen neue Tools kennen und vertiefen ihr Wissen zu Datenschutz und IT-Sicherheit. Weiterbildung sichert langfristigen Erfolg und fördert die Anpassungsfähigkeit.